1. Die Vorboten der neuen Zeit

Nadine im Uncanny Valley

„Nadine!“

Jetzt endlich bemerkt sie mich. Sie hebt ihren Kopf, schaut mich ruhig an und sagt: „Hi!“

Nadine wartet auf meinen nächsten Schritt. Während ich noch überlege, wie wir nun ins Gespräch kommen, wird ihr die Zeit zu lang. Sie lässt wieder ihre Hände über eine imaginäre Tastatur gleiten und versenkt ihren Blick in einen nicht existenten Bildschirm. Die Szene wirkt auf mich seltsam und irritierend. Ob ich mich an einer Hotelrezeption bei dieser ‚Frau‘ gut aufgehoben fühlen würde?

Nadine[1] ist Vorbotin einer neuen Zeit. Sie ist ein Roboterklon, dessen Äußeres 2013/14 nach der Professorin Nadia Magnenat Thalmann modelliert wurde. Aufgrund der Möglichkeit, Augenbrauen, Lider, Mund, Oberkörper und Arme zu bewegen, entsteht eine verwirrende Menschenähnlichkeit. Nadine ist auch ein sogenannter „Social Robot“, der mit seinem Gegenüber interagieren kann, z. B. indem er Fragen beantwortet oder scheinbar emotional mit Gestik und Mimik auf den Gesprächsinhalt reagiert.

Wer Nadine erlebt, bekommt eine Ahnung, wie Robotik und Künstliche Intelligenz (KI) zunehmend in vermeintlich dem Menschen vorbehaltene soziale Arbeitsbereiche vordringen. Ob nun die Realitätsnähe einer Nadine oder die erkennbare Roboterhaftigkeit eines „Peppers“ den zukünftigen Weg anzeigen, wird neben den technischen Möglichkeiten auch von gesellschaftlichen und individuellen Gewöhnungseffekten sowie persönlichen Vorlieben abhängen.

Die Erfahrung, dass wir Tamagotchis, Science-Fiction-Robotern und lebensgroßen Puppen für Erwachsene in der Vergangenheit eine Psyche bzw. Seele zugeschrieben haben, lässt vermuten, dass Androiden in nicht allzu ferner Zukunft einen festen Platz in unserer Gesellschaft einnehmen werden. Gerade angesichts der Überalterung werden sie wahrscheinlich zunehmend nützliche Aufgaben ausführen. Gut vorstellbar sind z. B. Pflegeroboter, die weitgehend immobilen Menschen bei dem Wechsel zwischen Bett und Rollstuhl sowie der Körperpflege helfen – und ihnen so ein Mindestmaß an Autonomie ermöglichen, durch das sie möglichst lange im eigenen Haus bleiben können.

Bis es soweit ist, wird der Schwerpunkt der Robotik auf einer zuverlässigen Unterstützung der menschlichen Pflegekräfte durch soziale Interaktion und Unterhaltung liegen.[2] Derzeit sind die Systeme noch viele Jahre davon entfernt, die menschlichen Pflegetätigkeiten in ihrer ganzen Komplexität nachzuvollziehen.

Menschenähnliche Social Robots wie Nadine müssen auch erst noch aus dem „Uncanny Valley“ gelangen, um eine feste Verwendung im menschlichen Leben zu erhalten. Als „unheimliches Tal“ bezeichnete Professor Masahiro Mori in den 70er-Jahren die Entwicklungsphase der Roboter, wenn diese zunehmend, aber noch nicht ganz menschengleich wirken und so bei Betrachtern für ein irritiertes und unheimliches Gefühl sorgen.[3]

Die Forschung zur Schnittstelle Mensch-Maschine schreitet weiter voran. Und je besser KI-Systeme die Körpersprache und Stimme sensorisch erfassen, desto zuverlässiger werden sie menschliche Emotionen erkennen (wenn auch noch nicht nachempfinden) können, bis sie darin so gut sind wie im Mittel der Mensch. Andere Forschungen befassen sich bereits mit geeigneten Interaktionsstrategien, damit die Systeme auf menschliche Gefühle angemessen reagieren und sie gegebenenfalls beeinflussen können. Dadurch verschaffen Social Robots bzw. ihre köperlosen Verwandten, Social Bots, in Zukunft eventuell etwa bedrückten Menschen Trost und Erleichterung.

Social Robot Nadine in der Ausstellung „Mensch, Roboter! – Leben mit Künstlicher Intelligenz und Robotik“ des Heinz Nixdorf MuseumsForums (HNF) in Paderborn. Das Video ist mit KI-Musik von Amper Music unterlegt.

Eine Technik für Katzenliebhaber (und andere)

Nachdem die KI zehn Milliarden Standbilder aus YouTube-Katzenvideos verarbeitet hatte, war es soweit: Sie hatte selbständig gelernt und konnte nun mit großer Sicherheit Katzen in für das System neuen Clips erkennen. So verhalfen merkwürdigerweise die vielbelächelten Katzenvideos im Jahr 2012 zu einem Meilenstein in der technischen Entwicklung.[4]

Künstliche Neuronale Netze (KNN) und Maschinelles Lernen (ML) haben in den letzten Jahren für große Fortschritte auf dem Gebiet der Künstlichen Intelligenz geführt. Sie sind insbesondere dort erfolgreich, wo große Datenmengen maschinenlesbar vorhanden sind und die Grundlage für das zuverlässige Anlernen des KNN bieten. Das ist jetzt schon bei Bild-, Sprach-/Ton- und Textdateien der Fall. Nach der Lernphase können KI-Systeme nicht nur mit geringer Fehlerhäufigkeit Katzen in YouTube-Videos erkennen, sondern z. B. auch Krebsanzeichen in Bildern (inklusive Röntgen, Ultraschall, MRT usw.).

Hierbei sind sie bereits heute erfolgreicher als Ärzte, die auf eine jahrelange Ausbildung und Erfahrung zurückblicken: So identifizierte ein KI-System Krebsanzeichen bei Muttermalen in 95 Prozent der Fälle korrekt, während die menschlichen Experten nur 86,6 Prozent richtig beurteilten. Ein anderes System wurde mittels ML so erfolgreich trainiert, dass es mit einer Genauigkeit von bis zu 97 Prozent Lungenkrebs diagnostizieren kann, was auf dem Niveau eines Pathologen liegt. Das Verfahren ist ebenso geeignet, um Krebsunterformen sowie Genmutationen zu erkennen und lässt sich auch für andere Krebsarten verwenden.[5] Bei der Krebstherapie verzeichnen KI-Systeme gleichfalls stetige Fortschritte. Sie haben gegenüber menschlichen Experten den grundsätzlichen Vorteil, dass sie bei der Analyse wesentlich schneller und ermüdungsfrei sind.

Wahrscheinlich werden KI-Systeme in Zukunft den Ärzten assistieren, insbesondere bei der Diagnose auf Basis von bildgebenden Verfahren, Laboruntersuchungen und Genanalysen usw. und der anschließenden Entwicklung von Therapievorschlägen. Pathologen und andere Ärzte werden sich somit auch zu Experten in der Anwendung von KI-Systemen entwickeln müssen, um mit ihrem breiten Erfahrungsschatz und ihren ganzheitlichen Fähigkeiten als Menschen entscheiden zu können, wo der digitale „Fachidiot“ Zusammenhänge außerhalb der antrainierten Lernerfahrung nicht erkennt.[6]

Reich werden mit KI

Kaum ein Wirtschaftsbereich verfügt über so viele kontinuierlich erhobene Daten wie die Finanzindustrie. Es ist daher naheliegend, diese Datenmengen durch KI-Systeme auswerten zu lassen, um die Vorhersagegenauigkeit bei Investitionsentscheidungen zu erhöhen. Und es funktioniert.

Für den Zeitraum von 1992 bis 2015 generierte ein Forscherteam um Dr. Krauss für jeden einzelnen Handelstag Vorhersagen für jede einzelne Aktie des amerikanischen S&P-500-Index. Auf Basis maschinellen Lernens konnten mit der gewählten Methode Renditen von mehr als 30 Prozent p. a. seit dem Jahr 2000 simuliert werden. In den letzten Jahren gingen die Renditen des Vorhersagemodells erheblich zurück, was Dr. Krauss u. a. einer Verbreitung des maschinellen Lernens an den Kapitalmärkten zuschreibt. Er sieht aber weiterhin großes Potenzial in den ML-Methoden.[7]

Mittlerweile handeln weitgehend autonome KI-Systeme bereits gegeneinander an den Finanzmärkten und der Bedarf an KI-Experten wächst signifikant, während der Bedarf an klassischen Tradern und Fondsmanagern eher abnehmen dürfte.[8]

Echte und Ware Kunst

Im Oktober 2018 wurde zum ersten Mal von einer Künstlichen Intelligenz geschaffene „Kunst“, ein eher unansehnliches Porträt, für den erstaunlichen Betrag von 432.500 US-Dollar (ca. 382.000 Euro) versteigert.[9] Aber kann KI überhaupt Kunst erschaffen und somit selbst ein Künstler werden?

Um diese Frage zu beantworten, ist zuerst zu klären, was „Kunst“ überhaupt ist – doch die Definition gelingt nicht einfach. Bei der Einordnung helfen die folgenden Aussagen von Professor Bernd Schmidt: Kunst sei kein Selbstzweck, vielmehr gehe es um „[n]aturgetreue Abbildung, Repräsentation, Propaganda, Unterrichtung, Unterhaltung, Erbauung, Provokation usw.“[10] Form und Originalität des Kunstwerks würden den Zweck unterstützen. Es „sollen in unterschiedlicher Weise Emotionen wachgerufen, Assoziationen geweckt, Wertungen abgegeben, Handlungsdispositionen aufgerufen oder ästhetische Empfindungen angeregt werden.“[11] Und Schmidt erklärt weiter: „Kunstwerke sind eine besondere Art von Kommunikationsobjekten, die Einstellungen vom Absender zum Empfänger übertragen.“[12]

Diese Definition macht sehr schnell klar, dass eine Maschine bzw. KI kein Künstler sein kann, solange sie kein Bewusstsein[13], keinen Willen und kein Wollen entwickelt. Derzeit simulieren die Systeme bestenfalls intelligentes Verhalten. Sie verfolgen keinen Zweck und wollen auch keine (eigene) Einstellung kommunizieren.

KI-Systeme können aber Handwerkszeuge von Künstlern sein oder künstlerische Prozesse simulieren – und das schon recht erfolgreich: Wer beispielsweise eine Hintergrund- oder „Fahrstuhl“-Musik benötigt, dem generiert der „AI Music Composer“ auf der Website von Amper Music eine durchaus angenehme Version (AI ist das englische Pendant zu „KI“ und steht für „Artificial Intelligence“) – das Video über Nadine (s. o.) ist mit einem Beispiel unterlegt. Alternative Produkte werden von diversen KI-Start-Ups und den Großkonzernen IBM sowie Google angeboten und finden ihren Einzug in den kreativen Schöpfungsprozess von Künstlern.[14] Auch hier stehen wir erst am Anfang. Wer mit der Komposition von „Fahrstuhl“-Musik seinen Lebensunterhalt verdient, dürfte es allerdings bereits in naher Zukunft schwer haben.

Gemeinsam lehrsam

In Deutschland sind auch nach Jahrzehnten der Automatisierung über 8 Millionen Menschen im produzierenden Gewerbe beschäftigt, das sind ca. 20 Prozent aller Erwerbstätigen. Was sicherlich am wirtschaftlichen Erfolg der hiesigen Exportindustrie liegt, aber auch an der großen Kluft zwischen Mensch und Roboter: Letztere können in komplexen, unübersichtlichen und dynamischen Situationen (noch) lange nicht so flexibel und feinmotorisch handeln. Der Mensch bewältigt derartige Situationen durch hochentwickelte Rückkoppelungsmechanismen, dank denen er unerwartete Störungen und Fehler aufgrund laufender sensorischer Informationen auch ad hoc kompensieren kann.

Solche menschähnlichen Rückkoppelungsmechanismen müssen Roboter erwerben, damit sie aus ihrer aktuellen starren, eng vorausgeplanten Fließbandfertigung als sogenannte Koboter (englisch „Cobots“) in hocheffiziente, flexible Mensch-Maschine-Produktionsteams[15] überführt werden können. Ein Versuch von Google und der Universität Berkeley im Jahr 2016 zeigt anschaulich den Weg: 14 Roboter mit Greifern sollten versuchen, unterschiedlichste Gegenstände aus einem Behälter zu nehmen und in einen anderen zu legen. Über die Zeit bildeten sie mithilfe maschinellen Lernens ein künstliches neuronales Netzwerk – und begannen nach 800.000 Greifversuchen, diese zu beobachten sowie in Echtzeit zu korrigieren. Sie lernten also selbständig Strategien, ganz ohne Programmierung.[16] Die Kluft zwischen Mensch und Maschine wird kleiner.

2. Automatisierung: Überblick und Ausblick

Die zuvor genannten Beispiele veranschaulichen, dass KI und Robotik die Automatisierung in immer mehr Tätigkeitsfelder tragen, die bisher dem Menschen vorbehalten waren. Zwar sind die Fortschritte der letzten Jahre auch aufgrund der großen Leistungssteigerungen in der Sensorik und Computertechnik spektakulär, z. B. der Sieg des PC-Programms AlphaGo über den menschlichen Go-Weltmeister. Aber es darf nicht übersehen werden, dass die bisherigen Fortschritte sich auf eng umgrenzte Aufgaben beschränken (sogenannte „schwache bzw. enge KI“) und es noch nicht möglich ist, die in der Breite wirkende menschliche Intelligenz nachzubilden (sogenannte „starke bzw. allgemeine KI“).

Einerseits ist die Projektion vergangener Entwicklungen und Erfolge in die Zukunft keine Methode, um das Ausmaß und den zeitlichen Verlauf des technischen Fortschritts sicher vorherzusagen. Entgegen den Erwartungen von Zukunftsforschern vergangener Dekaden sprengen wir heutzutage beispielsweise keine Schifffahrtsstraßen mit strahlungsarmen Atombomben[17] – und angesichts der wissenschaftlichen Erfolge der automatischen Textübersetzung Ende der 50er-Jahre[18] hatten viele einen früheren Durchbruch auf diesem Gebiet erwartet. Andererseits kann man die Folgen der Automatisierung auf die Beschäftigung methodisch am besten prognostizieren, indem man die derzeitigen technischen Möglichkeiten und die nach Expertenmeinung in den nächsten Dekaden wahrscheinlichen Fortschritte klärt.

Vor diesem Hintergrund und mit dem Blick auf den Arbeitsmarkt gefragt: Welche Entwicklungen und Faktoren bedrohen Jobs? Welche menschlichen Qualifikationen und Fähigkeiten einerseits sowie technischen Hürden andererseits sichern Arbeitsplätze oder schaffen neue?

Im Folgenden nähere ich mich diesen Fragestellungen mit einer Überblickssystematik. Sie beruht auf einer Veröffentlichung (2017)[19] des Fraunhofer-Instituts für Intelligente Analyse- und Informationssysteme (IAIS) sowie auf den bereits in meinem LinkedIn-Beitrag „Automatisierung: Jobkiller oder Jobmaschine? Teil 1: Analysen“ verwendeten Forschungsergebnissen:

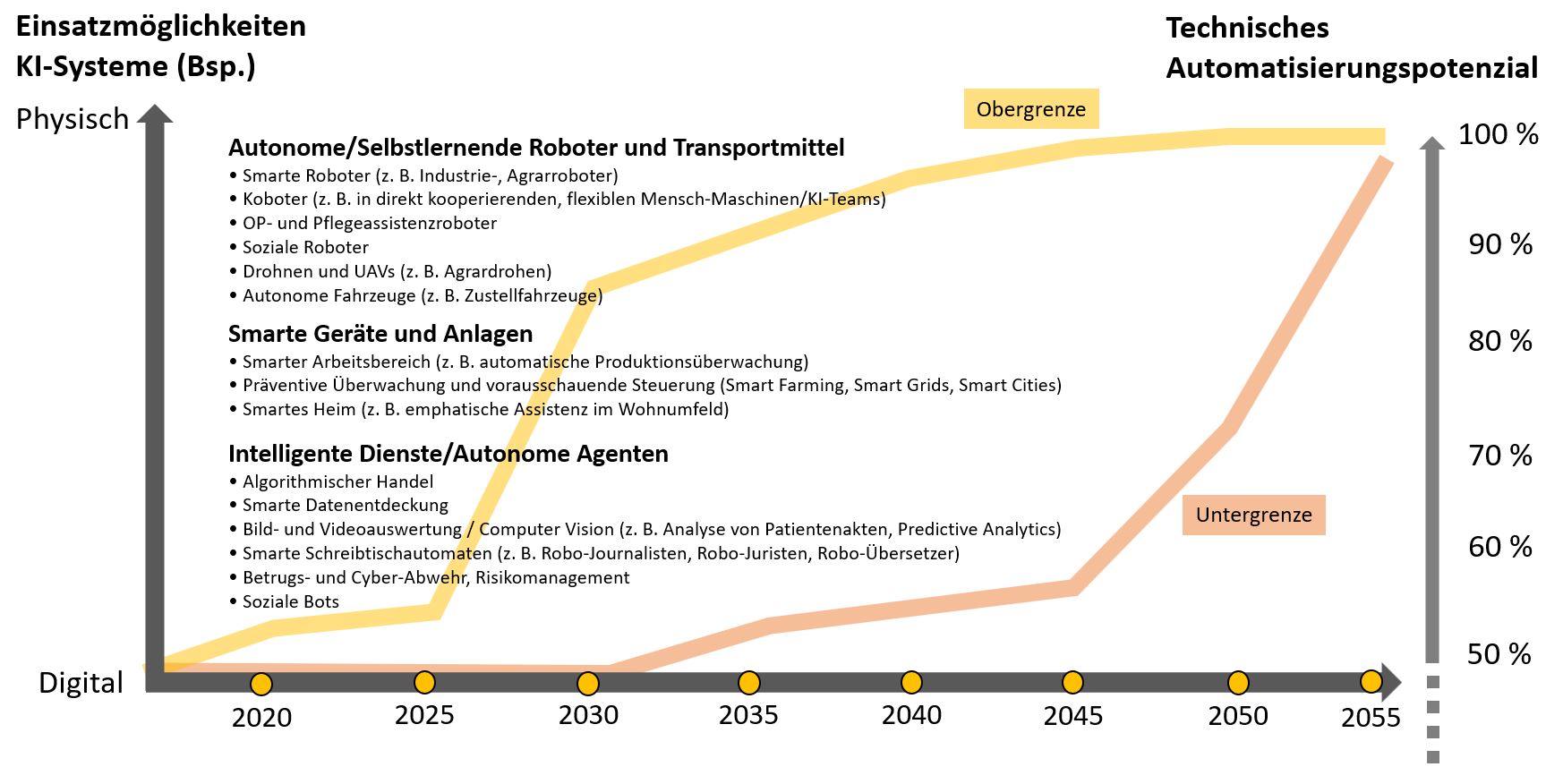

Die Abbildung 1 vereint eine Darstellung der Einsatzmöglichkeitenvon KI-Systemen mit dem prognostiziertem Automatisierungspotenzial. Obwohl die Übergänge fließend und keinesfalls überschneidungsfrei sind, können KIs dem Grad ihrer Verkörperung entsprechend als eher „digital“ oder eher „physisch“ an einer Achse aufgereiht werden. Intelligente Dienste und autonome Agenten können nicht autonom physisch wirksam werden. Ein System, das z. B. Hautkrebs erkennt, benötigt noch den Chirurgen, um das Geschwür zu entfernen. Im Gegensatz dazu können (zukünftige) Fahrzeuge, Drohnen, Roboter usw., die durch KIs autonom gesteuert werden, ihren Zweck mittels eines eigenen ‚Körpers‘ erreichen.

Die Darstellung der prognostizierten Unter- und Obergrenze des technischen Automatisierungspotenzials folgt der Analyse (2017)[20] des McKinsey Global Institutes. Nach Einschätzung der Autoren könnte das Potenzial durch die technischen Entwicklungen bereits ab Mitte des kommenden Jahrzehnts erheblich erweitert werden. Im Minimalszenario wird diese Entwicklung um 20 Jahre verzögert gesehen. In beiden Szenarien erscheint ein technischer Automatisierungsgrad von nahezu 100 Prozent um 2055 bis 2065 erreichbar.

Das tatsächliche Potenzial der Automatisierung wird weit länger unter den technischen Möglichkeiten bleiben, da es von vielen Rahmenbedingungen (Wirtschaftlichkeit, Regularien, Politik, gesellschaftliche Akzeptanz, Umsetzungspotenzial/-kapazitäten usw.) abhängt. Dies wird mit Blick auf das Beispiel Outsourcing deutlich: Auch hier würden die technischen und organisatorischen Möglichkeiten einen weit höheren Outsourcing-Grad erlauben, aber diesem Schritt stehen u. a. wirtschaftliche, regulatorische und unternehmenspolitische Überlegungen vielfach entgegen.

Nichtsdestoweniger bleibt das sich weitende technische Automatisierungspotenzial durch Fortschritte im Bereich des maschinellen Lernens und der Robotik eine Bedrohung für Arbeitsplätze.

3. Bedrohte Jobs

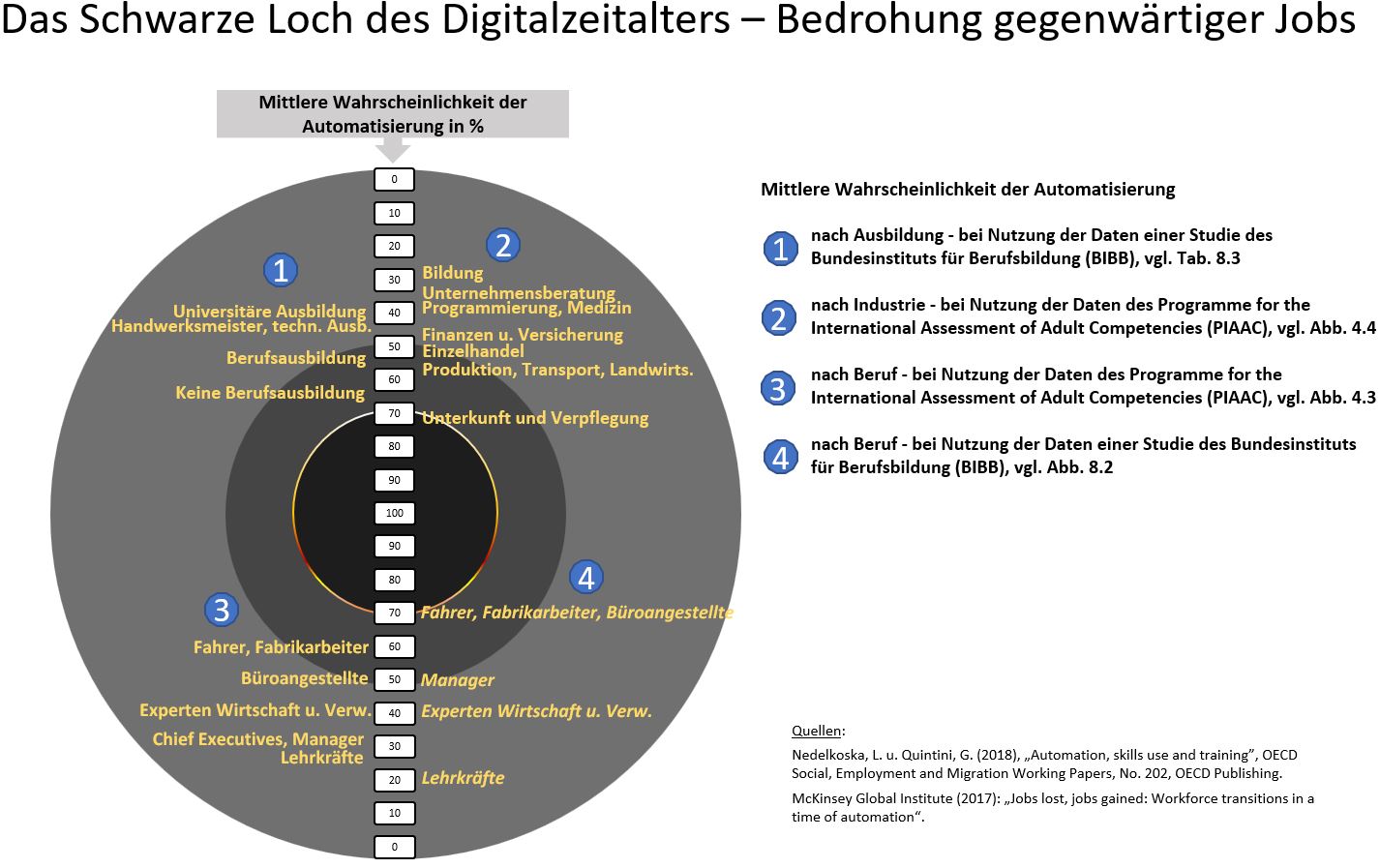

Die folgende Abbildung fußt auf den Ergebnissen einer OECD-Studie (2018)[21], welche die mittlere Wahrscheinlichkeit der Automatisierung nach Ausbildung, Industrie und Beruf analysiert. Ergänzt wurden die Daten mit den Ergebnissen einer weiteren Studie (2017) [22] des McKinsey Global Institutes.

Die Analyse bestätigt eine naheliegende Vermutung: Das Automatisierungsrisiko steigt mit einem sinkenden Qualifikationsniveau. Stark regelgeleitete, repetitive Aufgaben – ob in der Fabrik oder dem Büro – werden in den kommenden Jahrzehnten am ehesten durch KI-Systeme übernommen. Dadurch werden sich diese Stellen wandeln oder sind sogar von Abbau bedroht, wobei sich gefährdete Jobs insbesondere im primären und sekundären Sektor sowie im Logistikbereich befinden. Am sichersten sind Jobs, die ein sehr hohes Maß an allgemeiner und beruflicher Bildung, Sozialkompetenz, Problemlösungsfähigkeit und Kreativität erfordern. Diese finden sich in sogenannte „Knowledge Intensive Business Services“, wie z. B. einer Unternehmensberatung, und im Pflegebereich.

Interessanterweise erwarten die Forscher mit den geringsten Grad der Automatisierung in ihrem eigenen Berufsfeld Forschung und Lehre. Aber natürlich wird diese Entwicklung auch hier Einzug halten. Bereits jetzt werden KI-Systeme z. B. in der Forschung genutzt und es liegt nahe, diese Technologien in Zukunft darüber hinaus für ein individualisiertes Lernen bzw. eine individualisierte Lehre einzusetzen.

4. Neue Jobs

Das Aufkommen des Internets oder Smartphones wird oftmals als Beispiel dafür genannt, wie neue Technologien unvorhergesehene Geschäftsmodelle und Berufsfelder hervorbringen. Das ist erst recht bei einer technischen Entwicklung anzunehmen, die häufig als eine Revolution bzw. als „disruptiv“ mit Auswirkung auf alle Wirtschafts- und Gesellschaftsbereiche prognostiziert wird. Es lassen sich allerdings bereits Felder mit potenziellem Jobwachstum identifizieren:

- Forschung und Entwicklung von Automatisierungslösungen,

- Implementierung (z. B. Consulting, Anlernen von KI-Systemen),

- Betrieb (z. B. laufende Datenbereitstellung für ein kontinuierliches ML, operative Systemüberwachung, Qualitäts- und Funktionskontrolle der KI-Systeme bzw. des ML),

- Regulierung (z. B. Datenschutz, Ethik, Gesetzgebung, Politik),

- Neue Geschäftsmodelle, Produkte und Dienstleistungen aufgrund der Digitalisierung (z. B. Human Enhancement, Genetic Engineering),

- Lösungen und Dienstleistungen zur Bewältigung der Arbeitsmarktfolgen und sonstigen gesellschaftlichen Veränderungen (z. B. Life Purpose Consulting, Gaming und Leisure Consulting).

Die neuen Berufsfelder lassen sich also relativ gut umreißen, doch sie zu konkretisieren, ist schwieriger. Hierzu gibt es verschiedene Versuche. Beispielsweise hat die Commonwealth Scientific and Industrial Research Organisation (CSIRO) im Rahmen einer Studie (2016)[23] für den australischen Arbeitsmarkt vor dem Hintergrund der Digitalisierung über sechs neu entstehende Jobtypen spekuliert (siehe S. 76 ff.):

- BIGGER BIG DATA ANALYSTS: Bereits heutzutage werden Big-Data-Analysten händeringend gesucht. Für die Zukunft erwarten die Autoren eine stärkere Spezialisierung, die vertiefte Kenntnisse im Bereich des maschinellen Lernens, der Automatisierung, Cybersicherheit, Verschlüsselung und der verteilten (Cloud-basierten) Systeme und/oder branchenspezifisches Fachwissen erfordern.

- COMPLEX DECISION SUPPORT ANALYSTS: Aus dem Phänomen „Big Data“ erwächst die Herausforderung „Big Decisions“. Das Mehr an Informationen liefert mehr Handlungsoptionen und macht Entscheidungen dadurch komplexer. Es besteht die Gefahr, dass Entscheidungsträger durch die Vielzahl an Daten und Optionen gelähmt werden – womit der Bedarf entsteht, die Informationen auszuwerten und zu gewichten. Spezielle Analysten helfen, die Fragen in Zusammenhang mit einer Entscheidung zu stellen, zu strukturieren und mithilfe von KI zu beantworten.

- REMOTE CONTROLLED VEHICLE OPERATORS: Mit dem Aufkommen von unbemannten Flugzeugen (Drohnen) und Fahrzeugen steigt der Bedarf an Experten, die diese Maschinen in der Luft, am Boden oder auf dem Wasser fernsteuern und kontrollieren. Auch beim Fortschreiten der Automatisierung wird vermutlich in absehbarer Zeit nicht auf die menschliche Kontrolle unbemannter Fahrzeuge verzichtet.

- CUSTOMER EXPERIENCE EXPERTS: In Organisationen wird die Kundenorientierung weiter an Bedeutung gewinnen. Die Autoren der CSIRO-Studie erwarten, dass das auch Ausdruck in neuen Rollen wie dem Chief Experience Officer (CXO) und dem Chief Customer Officer (CCO) finden wird. In diesem Zuge wird der Bedarf an Beratern wachsen, die den C-Level-Funktionsträgern zuarbeiten bzw. in ihrem Sinne handeln und sich auf die Bedürfnisse der Kunden sowie der Gesellschaft insgesamt fokussieren. Beispielsweise könnten in Zukunft Supermärkte zu Ausstellungsflächen mutieren, wo Kunden bei der passenden Produktauswahl beraten werden. Die logistischen Aktivitäten sind dann schon automatisiert.

- PERSONALISED PREVENTATIVE HEALTH HELPERS: Diese Rolle kann als Weiterentwicklung des persönlichen Fitnesstrainers verstanden werden. Die Autoren rechnen damit, dass sich deren Aufgabenfeld in Richtung eines generalistischen Beraters für Lifestyle, Wohlbefinden und Gesundheitsprävention erweitert, der auch moderne Informationstechnologien nutzt.

- ONLINE CHAPERONES: In diesem Berufsfeld der Cybersecurity geht es um die Schadensvermeidung bzw. -begrenzung bei Belästigung und Betrug im Internet, etwa bei Identitätsdiebstahl, Reputationsschäden und Mobbing in den sozialen Medien.

Die vorgenannten Überlegungen sind spekulativ und können hinterfragt werden. Warum sollten z. B. Konsumenten, die sich heutzutage bequem im Internet über Produkte informieren und diese bei Amazon u. Ä. kaufen, sich künftig umständlich zu einer Ausstellungsfläche begeben, um dort von Menschen beraten zu werden? Vieles liegt derzeit noch im Nebel. Die Überlegungen lassen aber auch die große Bandbreite an neuen Jobs erahnen, die sich im Zuge der weiteren Automatisierung und damit einhergehenden gesellschaftlichen Veränderungen ergeben werden.

Möglicherweise wird die Anzahl der Jobs, die durch die Automatisierung direkt oder indirekt geschaffen wird, tatsächlich die der verdrängten ausgleichen oder sogar übertreffen. Durch die neuen und in der Regel anspruchsvolleren Berufsfelder werden bei uns Menschen Lücken in Wissen und Fähigkeiten entstehen. Sofern wir nicht darauf spekulieren, dass diese Lücken in absehbarer Zukunft durch pharmakologisches, technisches oder genetisches Neuro-Enhancement ausgeglichen werden, wird es Verlierer am Arbeitsmarkt geben.

Was das für die Gesellschaft der Zukunft bedeuten mag, beleuchte ich in meinem nächsten Beitrag, bevor ich im vierten Teil wieder den Blick einenge und Antworten auf die Zukunftsfragen aus der Perspektive des Personalbereichs suche.

Wer die nächsten Beiträge nicht verpassen will, sollte newmodelhr auf Twitter folgen und kann sich gerne mit mir auf LinkedIn vernetzen. Fragen und Anregungen gerne an: robert.schindler@newmodelhr.com.

PS: Dieser Beitrag ist rein privat und steht in keinem Zusammenhang mit Firmen oder Organisationen.

Quellenverzeichnis:

[1] Vgl. Gieriet, Marc (2016): „Ein Roboter als Lebensgefährte“, SRF-Web, https://www.srf.ch/sendungen/dok/ein-roboter-als-lebensgefaehrte (zuletzt aufgerufen am 27.11.2018);

Wikipedia (2018): „Nadine Social Robot“, https://en.wikipedia.org/wiki/Nadine_Social_Robot (zuletzt aufgerufen am 28.10.2018); MIRALab, http://www.miralab.ch/ (zuletzt aufgerufen am 27.11.2018).

[2] Vgl. Wallenfels, Matthias, (2017): „Pflege-Assistenzsysteme – Spagat zwischen Fortschritten und Rückschlägen“, Ärzte Zeitung Online, https://www.aerztezeitung.de/politik_gesellschaft/pflege/article/940481/assistenzsysteme-spagat-zwischen-fortschritten-rueckschlaegen.html?sh=1&h=366803679(zuletzt aufgerufen am 28.10.2018).

[3] Wer selbst mit Nadine ins Gespräch kommen und seine Gefühle im „Uncanny Valley“ erleben will, kann sie bei der Ausstellung „Mensch, Roboter! – Leben mit Künstlicher Intelligenz und Robotik“ des Heinz Nixdorf MuseumsForums (HNF) in Paderborn besuchen.

[4] Vgl. Meisinger, Dominik (2018): „Katzenvideos“, Forbes, deutschsprachige Ausgabe, https://www.forbes.at/artikel/katzenvideos.html (zuletzt aufgerufen am 08.11.2018).

[5] Vgl. Coudray, Nicolas et al. (2018): „Classification and mutation prediction from non–small cell lung cancer histopathology images using deep learning“, Nature Medicine, Vol. 24, S. 1559–1567, https://doi.org/10.1038/s41591-018-0177-5 (zuletzt aufgerufen am 28.10.2018).

[6] Vgl. Schaffrath Rosario, Tobias (2018): „So kann Künstliche Intelligenz im Kampf gegen Krebs helfen“, WIRED Germany, https://www.wired.de/article/so-kann-kuenstliche-intelligenz-im-kampf-gegen-krebs-helfen (zuletzt aufgerufen am 21.11.2018).

[7] Vgl. Krauss, Christopher; Do, Xuan Anh; Huck, Nicolas (2016): „Deep neural networks, gradient-boosted trees, random forests: Statistical arbitrage on the S&P 500“, FAU Discussion Papers in Economics, Nr. 03/2016, Friedrich-Alexander-Universität Erlangen Nürnberg, Institute for Economics, Erlangen, http://hdl.handle.net/10419/130166 (zuletzt aufgerufen am 16.11.2018). Ergänzend: Internet der Fakultät der School of Business and Economics der Friedrich-Alexander-Universität Erlangen-Nürnberg (FAU), https://www.wiso.rw.fau.eu/2017/03/01/deep-learning-in-finance (zuletzt aufgerufen am 16.11.2018). Ebenfalls zu Potential und derzeitigen Einschränkungen: Lu, Longfei (2018): „AI Robotic Trader – Eine neue Ära im Wertpapierhandel?“, Handelsblatt, https://veranstaltungen.handelsblatt.com/ai-banking/ai-robotic-trader-eine-neue-aera-im-wertpapierhandel (zuletzt aufgerufen am 16.11.2018).

[8] Vgl. Gans, Joshua (2018), „Opinion: AI will change stock-market trading, but it can’t wipe out the human touch“, https://www.marketwatch.com/story/ai-will-change-stock-market-trading-but-it-cant-wipe-out-the-role-of-people-2018-05-15 (zuletzt aufgerufen am 16.11.2018).

[9] Vgl. Cohn, Gabe (2018): „AI Art at Christie’s Sells for $432,500“, The New York Times, https://nyti.ms/2AskZoD (zuletzt aufgerufen am 15.11.2018).

[10] Schmidt, Bernd (2006): „Kunst, was ist das?“, in: Aufklärung und Kritik 2/2006, http://www.gkpn.de/schmidt_kunst.pdf (zuletzt aufgerufen am 29.10.2018).

[11] ebd.

[12] ebd.

[13] Vgl. Mørch, Hedda Hassel (2018): „Wie kommt der Geist in die Natur?“, Frankfurter Allgemeine Zeitung, http://www.faz.net/-ibq-960zh (zuletzt aufgerufen am 29.10.2018).

[14] Vgl. Moorstedt, Michael (2018): „Künstliche Kunst“, Süddeutsche Zeitung, https://www.sueddeutsche.de/digital/kuenstliche-intelligenz-computerkunst-1.4188338 (zuletzt aufgerufen am 29.10.2018).

[15] Vgl. Daugherty, Paul R.: „Human + Machine: Künstliche Intelligenz und die Zukunft der Arbeit“ (original: „Humane + Machine. Reimagining Work in the Age of AI“), Kindle-Version, S. 10 ff., sowie Fraunhofer-Allianz Big Data (2017), S. 15.

[16] Vgl. Levine, Sergey, Google AI Blog (2016): „Deep Learning for Robots: Learning from Large-Scale Interaction“, https://ai.googleblog.com/2016/03/deep-learning-for-robots-learning-from.html (zuletzt aufgerufen am 19.11.2018).

[17] Vgl. DER SPIEGEL (1964): „PANAMA-KANAL: Bomben auf den Isthmus“, http://www.spiegel.de/spiegel/print/d-46163000.html (zuletzt aufgerufen am 30.10.2018).

[18] Vgl. DER SPIEGEL (2/1958): „ÜBERSETZUNGS-MASCHINEN: Die Wortfabrik“, http://www.spiegel.de/spiegel/print/d-41760407.html (zuletzt aufgerufen am 30.10.2018).

[19] Vgl. Fraunhofer-Allianz Big Data (2017): „Zukunftsmarkt Künstliche Intelligenz – Potenziale und Anwendungen“, https://www.iuk.fraunhofer.de/content/dam/iuk/de/documents/KI-Studie_Ansicht_201712.pdf (zuletzt aufgerufen am 21.11.2018).

[20] Vgl. McKinsey Global Institute (2017a): „A future that works: Automation, employment, and productivity – Executive Summary“, https://www.mckinsey.com/~/media/mckinsey/featured Prozent20insights/Digital Prozent20Disruption/Harnessing Prozent20automation Prozent20for Prozent20a Prozent20future Prozent20that Prozent20works/MGI-A-future-that-works-Executive-summary.ashx (zuletzt aufgerufen am 21.11.2018).

[21] Vgl. Nedelkoska, L. &. Quintini, G. (2018): „Automation, skills use and training“, OECD Social, Employment and Migration Working Papers, Nr. 202, OECD Publishing, Paris, http://dx.doi.org/10.1787/2e2f4eea-en (zuletzt aufgerufen am 21.11.2018).

[22] Vgl. McKinsey Global Institute (2017b): „Jobs lost, jobs gained: Workforce transitions in a time of automation“, https://www.mckinsey.com/~/media/McKinsey/Featured Prozent20Insights/Future Prozent20of Prozent20Organizations/What Prozent20the Prozent20future Prozent20of Prozent20work Prozent20will Prozent20mean Prozent20for Prozent20jobs Prozent20skills Prozent20and Prozent20wages/MGI-Jobs-Lost-Jobs-Gained-Executive-summary-December-6-2017.ashx (zuletzt aufgerufen am 21.11.2018).

[23] Vgl. Hajkowicz, Stefan et al. (2016): „Tomorrow’s Digitally Enabled Workforce: Megatrends and scenarios for jobs and employment in Australia over the coming twenty years“, CSIRO, Brisbane, https://www.acs.org.au/content/dam/acs/acs-documents/16-0026_DATA61_REPORT_TomorrowsDigiallyEnabledWorkforce_WEB_160128.pdf (zuletzt aufgerufen am 21.11.2018).